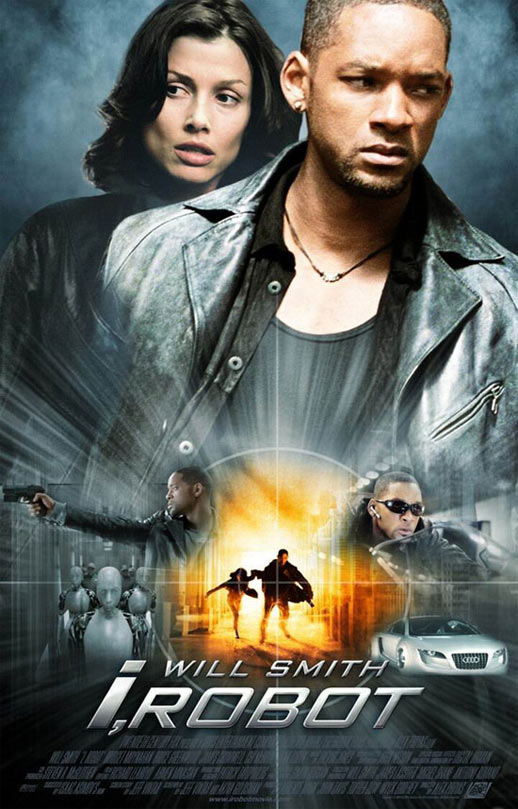

El inspector Spooner (Will Smith), protagonista de la película Yo, robot (Alex Proyas, 2004) se manifiesta totalmente tecnófobo en un futuro (año 2035) en el que robots de todo tipo realizan gran parte del trabajo y se han convertido en los asistentes personales perfectos para el ser humano. Sistemas capaces de ser programados para realizar la demolición de un edificio a la hora señalada, coches que conducen de forma autónoma sin intervención humana o vehículos dotados con la capacidad de recoger al momento los restos de un accidente de circulación son sólo algunos ejemplos de la presencia de las máquinas en la vida de estos humanos del futuro. Los robots estrella al comienzo de la película son los humanoides NS-4, que ofrecen todo tipo de asistencia y compañía a sus dueños.

La razón de la aprensión de Spooner hacia estas máquinas tiene mucho que ver con un dilema planteado en un estudio científico publicado recientemente. Tras un accidente de tráfico, el vehículo de Spooner y otro quedan sumergidos en el río Chicago con sus ocupantes dentro. Un camión les acaba de arrollar. El protagonista de la historia viaja solo, pero en el otro coche, además del conductor, que muere en el acto, se encuentra una niña de 12 años en el mismo aprieto. Un robot NS-4 acude por propia iniciativa al rescate y, según sus algoritmos, decide salvar en primera instancia a Spooner porque tiene una probabilidad mayor de sobrevivir. Desobedece, por tanto, a sus órdenes instándole a que salve a la pequeña.

Tras una dura recuperación física todavía le quedan secuelas psicológicas, entre ellas, la tecnofobia y la predilección por objetos del pasado, sean tecnológicos o no. Spooner no soporta que la niña muriese porque el robot decidiese salvar su vida primero, y ello lo convierte en el hombre perfecto para llevar a cabo la investigación policial en la que se basa la historia de la película.

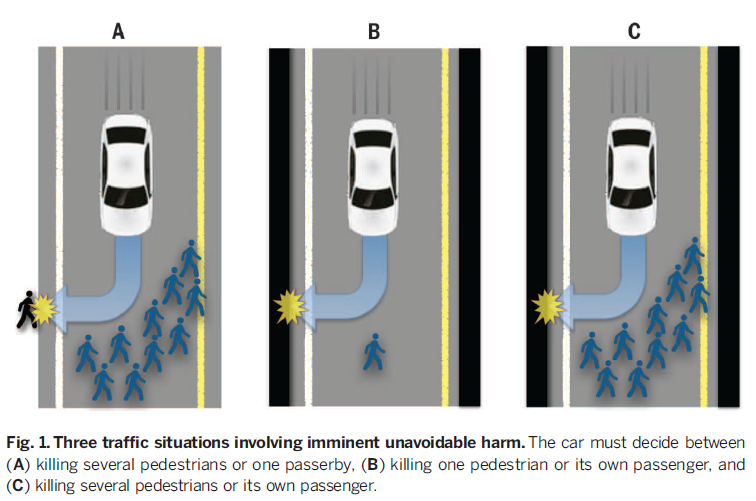

El pasado 5 de julio se publicó en la revista Science un trabajo de investigación, liderado por Iyad Rahwan del MIT (Instituto Tecnológico de Massachusetts), en el que se plantea los dilemas sociales a la hora de establecer los criterios de actuación de los vehículos autónomos ante situaciones de peligro en las que debe decidir qué vidas sacrificar o salvar. Mediante distintas encuestas realizadas a través de la herramienta de Amazon Mechanical Turk, en la que usuarios reciben una pequeña compensación (hablamos de centavos) por rellenar cuestionarios de todo tipo para los más diversos propósitos, los sujetos de estudio debían elegir ante distintas situaciones y contestar varias preguntas. Los escenarios presentados consistían básicamente en elegir entre atropellar a peatones (en distinto número) o inmolar a los ocupantes del coche autónomo mediante un volantazo que supondría el impacto contra un muro. El número de personas a salvar es uno de los criterios estrella a la hora de elegir la opción moral más adecuada para los participantes en el estudio. Es decir: el mal menor y el bien común. Sin embargo, los investigadores observaron que eran reticentes a la hora de comprar un vehículo capaz de sacrificar su integridad física y la de sus copilotos (familiares o amigos) a pesar de que según sus principios morales lo correcto sería que el coche se comportase de ese modo. Es decir, cuando se personaliza es mucho más difícil asumir una postura ética altruista.

De todos modos, hay muchos más factores que se deberían tener en cuenta a la hora de tomar la decisión, como por ejemplo el incumplimiento de las normas de circulación (¿perdería prioridad de ser salvado quien viola el código vial?), la edad, o la condición física de los sujetos sobre los que se debe establecer la valoración.

En todo caso, además de los algoritmos, queda pendiente una mejora sustancial de los sensores para que dicha información llegue de forma correcta al ordenador del vehículo. Todavía está reciente el caso del Tesla S que no fue capaz de detectar un camión que realizó una maniobra inadecuada y por ello no reaccionó ante una situación que acabó con la vida del conductor y orgulloso propietario de este vehículo autónomo cuyos fabricantes, por otra parte, recomiendan utilizar el modo autónomo siempre y cuando el conductor permanezca alerta.

Es fundamental una regulación adecuada en estos casos y en otros mucho más complejos para que esta tecnología, que en la teoría reduciría el número de accidentes al eliminar las infracciones derivadas del comportamiento humano, salga a la calle, pero estos dilemas morales suponen un factor que retrasa su comercialización. Lo lógico sería que todos los coches autónomos tuviesen la misma regulación para que todos los conductores y tripulantes tuviesen las mismas probabilidades de sobrevivir ante similares situaciones de peligro, pero si no se llega a un consenso puede ocurrir que un futuro con coches que conduzcan sin intervención humana nunca llegue. Otra cuestión es que se puedan hackear los algoritmos para que el coche actúe según el criterio de su propietario.

En el caso de Yo, robot la tecnología, obviamente, se encuentra en un estado más avanzado. El robot que salvó la vida del inspector Spooner tomó su decisión en función de las distintas posibilidades de supervivencia de ambos humanos tras el accidente, lo cual denota la gran cantidad de información capaz de ser captada por el androide. Sin embargo, en este caso nuestro protagonista hubiese preferido ser el sujeto sacrificado, una decisión que, según él, cualquier ser humano hubiese tomado. La cuestión es: ¿y si el robot tuviese que elegir entre esa niña y uno de sus vástagos? ¿Consideraría adecuado su criterio?

Atribución de la imagen de portada:

https://commons.wikimedia.org/wiki/File:Masudaya_Mini_Replica_X-9_Robot_Car_Side.jpg

Deja tu comentario